News Message

DeepMind Reinforced Attention Learning

- by wittx 2026-03-04

用户发布的文档

Reinforced Attention Learning 由 UC Davis、Princeton、Google 和 Google DeepMind 的研究员联合发表于 2026 年 2 月。

我们都知道,在大语言模型(LLM)时代,强化学习后训练(Post-training with RL) 是提升模型推理能力的关键技术,尤其是通过 Test-time scaling(测试时计算扩展),让模型“多想一会儿”,效果显著。自然地,大家也想把这套逻辑搬到多模态大模型(MLLMs)上,让模型在回答视觉问题前先生成一大段“思维链(CoT)”。

但作者敏锐地发现了一个问题:对于需要细腻感知的视觉任务,这种“长篇大论”的推理不仅收益微薄,甚至可能适得其反。

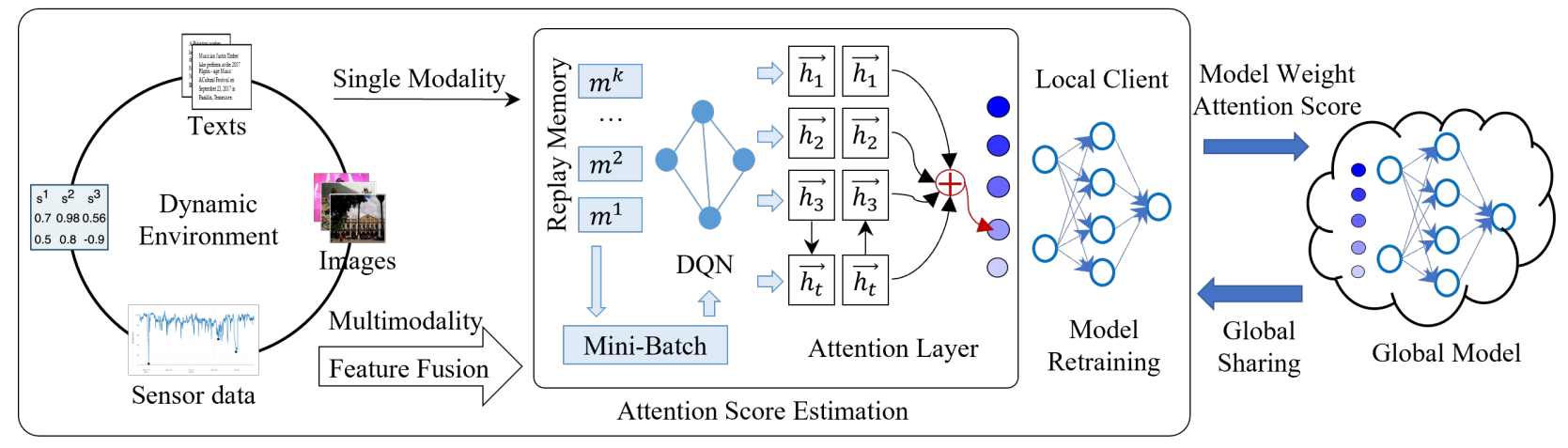

针对这一痛点,本文提出了一个非常底层的创新视角:Reinforced Attention Learning (RAL)。与其像传统 RL 那样优化“输出什么词”(what to generate),不如直接优化模型内部“关注哪里”(where to attend)。他们将 Transformer 内部的注意力分布(Attention Distribution) 直接视为优化的策略(Policy),让模型在奖励信号的驱动下,学会更精准地聚焦于图像或视频中的关键区域。

这篇论文的思路非常清奇且直击本质。它跳出了“Next-token Prediction”的桎梏,试图通过显式地修正注意力模式来增强模型的 Grounding(落地/对齐)能力。实验证明,这种方法在视频和图像问答任务上,比现在的当红炸子鸡 GRPO 还要好。

1. Introduction

在这一章,作者首先指出了将 LLM 的推理范式直接迁移到多模态领域的局限性,并一针见血地分析了原因:感知任务的核心在于“看对地方”,而非“多说话”。基于此,作者引出了本文的核心方法论——将优化目标从 Token 转移到 Attention。

我们见证了 LLM 在数学和编程等复杂领域的惊人表现,这很大程度上归功于大规模无监督预训练和随后的强化学习后训练(Post-training with RL)。

目前的各种 Post-training 方法,本质上都是利用奖励信号来优化模型的策略,鼓励模型生成高价值的 Token 序列。

从本质上讲,这些策略梯度方法(Policy Gradient Methods)是在微调 Next-token Distribution(下一个词的概率分布),以最大化期望奖励。

最近的研究更是强调了“推理长度”与“任务准确率”之间的强相关性,这就是大家津津乐道的 Test-time Scaling。

为了将这种红利扩展到 多模态大模型(MLLMs),很多人尝试在 视觉问答(VQA) 任务中引入“思考过程”。也就是让模型在给出最终答案之前,先生成一段详尽的视觉描述作为思维链(CoT)。

❓ 为什么 LLM 的 CoT 经验在多模态感知任务上失效了?

作者发现,虽然在逻辑推理任务上 CoT 很有效,但对于核心感知任务(Core Perception Tasks)——比如图像或视频问答——通过生成大量文本来进行推理,收益非常有限,甚至会因为“幻觉”或“跑题”导致性能下降。

这就好比你问一个人“图里这只鸟是什么品种”,他如果开始长篇大论地分析鸟类进化的历史,反而容易忽略图里那只鸟嘴巴的细节特征。感知需要的是“精准的注视”,而不是“冗长的陈述”。

作者认为,这个问题的根源在于:

Next-token Prediction(下一个词预测)作为 MLLM 后训练的基础策略目标,可能是不够的。

在典型的 MLLM 架构中,视觉输入被编码成 Token,投射到文本嵌入空间中。要准确回答细粒度的问题,模型必须精确地识别并关注与任务相关的视觉信息。这个过程是由 Transformer 的注意力机制(Attention Mechanism) 主导的,它决定了给哪些 Token 分配更高的权重。

然而,标准的 RLHF(基于人类反馈的强化学习) 优化的是结果(Token),而不是过程(内部的信息分配)。

受到这一观察的启发,作者提出重新制定 MLLM 的后训练策略,让它直接作用于生成过程中的注意力分布(Attention Distribution)。这就是本文提出的 Reinforced Attention Learning (RAL)。

RAL 旨在优化模型,使其产生高效用的注意力轨迹。与传统方法不同,RAL 将注意力模式本身视为策略(Policy):

•

当一个回答获得高奖励时,算法会通过最小化当前策略与参考策略(Reference Policy)之间的散度,来鼓励这种底层的注意力分布。

•

反之,对于低奖励的回答,模型会通过增加散度来受到惩罚,从而远离那些次优的注意力模式。

通过将优化目标从“Token 似然度”转移到“基于注意力的分配”,RAL 能更直接地对 MLLM 进行多模态对齐微调。实验表明,RAL 在视频和图像基准测试上始终优于 GRPO (Group Relative Policy Optimization),特别是在那些感知密集型的任务上。

💡 核心洞察:RAL 的本质是什么?

RAL 的本质是一次优化对象的降维打击。

传统的 RLHF 是在说:“只要你说出了正确的答案,我就给你糖吃。”(结果导向,What to generate)

RAL 是在说:“我看你刚才盯着图像的左上角看,然后答对了,这很好,下次继续盯着这儿看。”(过程导向,Where to focus)

它试图通过奖励信号,去反向修正模型内部“看东西”的习惯,让模型探索出一种高效的“信息收集策略”(Information-gathering Policy)。

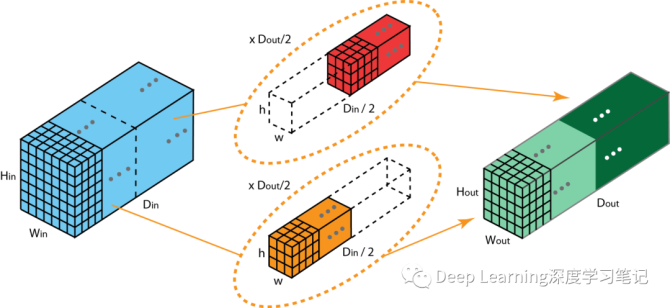

此外,优化注意力分布的有效性还可以自然地延伸到 On-Policy Distillation(在线策略蒸馏)。传统的蒸馏侧重于 Token 级别的概率对齐,而作者提出了一种双重蒸馏方法(Dual-distillation),即同时进行 Token 对齐和注意力分布对齐。实验表明,加入注意力蒸馏能带来显著的额外性能提升。

总结一下,本文的主要贡献如下:

1.

Reinforced Attention Learning (RAL):提出了一种策略梯度方法,将优化目标从 Next-token Prediction 转移到 Attention-distribution Alignment(注意力分布对齐),从而通过直接强化视觉 Grounding,而不是通过文本输出进行间接监督。

2.

On-Policy Attention Distillation:将框架扩展到在线策略蒸馏设置,显著提高了学生模型从教师模型继承细粒度感知和 Grounding 行为的能力。

3.

实证验证(Empirical Validation):大量实验证明,在需要细粒度视觉理解和感知的各类 VQA 基准上,RAL 的表现持续优于 GRPO。

本章小结

第一章清晰地界定了研究动机:多模态模型在感知任务上不能简单照搬文本模型的 CoT 策略。作者指出,问题的症结在于现有的优化手段(Next-token Prediction)无法直接触达感知的核心机制——注意力。因此,本文提出了 RAL,旨在直接利用 RL 信号去“修剪”和“塑造”模型的注意力分布,使其学会像人类一样在感知时“聚焦重点”。

2. Related Works

在这一章,我们来梳理一下 RAL 的技术坐标系。作者回顾了 LLM 强化学习后训练的发展脉络,以及知识蒸馏技术的演进,从而更清晰地定位了 RAL 在这两个领域交叉点上的独特价值。

2.1. Post training LLMs through Reinforcement Learning(通过强化学习进行 LLM 后训练)

现在,后训练(Post-training) 已经成为让 LLM 对齐人类意图的标准操作。

经典的 RLHF(Reinforcement Learning from Human Feedback) 流程大家都很熟悉了:先做 SFT(有监督微调),再训练一个 RM(奖励模型) 来模拟人类偏好,最后通过 RL 算法(如 PPO)来优化策略。

然而,当我们将这套逻辑搬到 多模态 LLM(MLLMs) 时,遇到了新问题:幻觉(Hallucination) 和 跨模态 Grounding(对齐/落地) 的缺失。

作者特别提到了一个顽疾:模态偏差(Modality Bias)。

•

有时候,模型太依赖语言先验(Linguistic Priors),看都不看图就瞎猜;

•

有时候,模型又过度拟合于肤浅的视觉线索(Superficial Visual Cues)。

现有的很多工作试图通过设计复杂的奖励函数来惩罚这些“走捷径”的行为。但本文作者认为,与其在奖励函数上打补丁,不如从源头解决问题:

利用 Attention 这一根本的信息选择机制。

既然跨模态推理依赖于识别关键证据,那么直接控制注意力权重(Attention Weights),显然比仅仅控制输出的文本 Token 要更本质、更符合第一性原理。

2.2. Distilling knowledge and beyond from teacher to student models(从教师到学生的知识蒸馏及超越)

知识蒸馏(Knowledge Distillation, KD) 的核心思想是让“学生模型”模仿“教师模型”。

传统的 KD 通常是让学生去匹配教师输出的软概率分布(Softened Output Distributions),而不是硬标签。这在模型压缩和领域适配中非常有用。在大模型时代,蒸馏的对象也从 Output Logits 扩展到了中间层表示、Attention Map 等。

进阶玩法:On-policy Distillation(在线策略蒸馏)

最近的研究开始探索 On-policy Distillation。

与传统在静态数据集上进行的离线 KD 不同,On-policy 蒸馏是让 学生模型自己生成回答(Under its own policy),然后由教师模型对这些生成的轨迹进行评估和指导。

为什么要这么做?

因为它能缓解“暴露偏差”(Exposure Bias)——即训练时老师教的是标准答案,测试时学生自己写可能会跑偏。让学生在训练时就“自己写、老师改”,能更好地对齐测试时的行为,同时保持监督学习的稳定性。

在本文中,作者将这一理念推向了新的高度:On-policy Attention Distillation。

这不仅仅是让学生模仿老师的答案(Token),更是在 On-policy 的框架下,让学生模仿老师“思考时的目光”(Attention Distribution)。这就为学生模型提供了一种原则性的结构化正则(Structural Regularization),确保学生不仅答对了,而且是因为“看懂了”才答对的。

本章小结

这一章为 RAL 奠定了理论基础:它继承了 GRPO 的高效 RL 思想,但解决了其在多模态感知上的不足;它借鉴了 On-policy Distillation 的先进范式,但引入了独特的 Attention 维度监督。作者通过对现有工作的梳理,指出了“Token 级优化”在多模态对齐上的局限性,从而突显了“直接优化 Attention”的必要性。

3. Reinforced Attention Learning

在这一章,作者正式端出了主菜——Reinforced Attention Learning (RAL) 的数学形式化描述。这一章的核心在于回答一个问题:如果我们不只盯着“输出结果”(Token),而是盯着“思维过程”(Attention),强化学习的目标函数该长什么样?作者在这里推导了一套基于注意力分布的策略梯度算法,并将其进一步扩展到了在线蒸馏(On-Policy Distillation)场景。

3.1. Aggregated causal Attention Distribution Policy

我们先来看看传统的 LLM 强化学习是怎么做的。通常,PPO 或 GRPO 这样的算法优化的是输出 Token 分布上的期望回报。公式通常长这样:

这里的 A_t 是优势函数(Advantage)。这个公式直白地说就是:如果一个动作(生成的词)带来了正向的回报,就提高它出现的概率;反之则降低。

传统 Token 级优化的隐患:Diversity Collapse(多样性坍缩)

作者指出,显式地优化 Token 分布的差异(Divergence)虽然能提高即时奖励,但往往会导致模型过度拟合到特定的高分句式或表面形式。

这就是所谓的“Reward Hacking”——模型学会了套话、废话,而不是学会了真正的推理逻辑。这就像一个学生为了拿高分,死记硬背标准答案的“解题套路”,而不是真正理解了题目。

为了缓解这个问题,作者提出:

将优化目标从外部的输出分布(Output Distribution)转移到内部的注意力分布(Internal Attention Distribution)。

作者认为:

模型的内部注意力机制构成了一个替代的、潜在的策略空间(Latent Policy Space)。

具体定义如下:

假设生成的序列是 $S = (x_1, ..., x_T)$,其中 x_1...x_P 是提示词(Prompt),$x_{P+1}...x_T$ 是生成的回答。

对于每一个生成的 Token $t$,我们定义它的因果注意力分布策略(Causal Attention Distribution Policy)p_\theta^t 为它对所有前序位置 i 的关注度:

这里 \alpha_{t,i} 是从最后一层提取并对所有注意力头取平均后的注意力权重。

为什么要对所有 Head 取平均?

Transformer 有很多层,每层有很多头(Head)。作者在这里做了一个简化处理:取最后一层(Final Layer),并对所有头取平均。

这背后的直觉是:最后一层通常汇聚了最高层的语义信息和推理结果,而平均化则提取了一种“全局的关注倾向”,忽略掉个别 Head 的特异性功能,从而将注意力模式抽象为一个统一的“信息收集策略”。

3.2. Advantage-Weighted Attention Divergence

定义好了“注意力策略”,接下来就要设计 Loss 函数了。

作者的目标是:让高奖励的回复对应的注意力模式被保留和增强。

受 PPO/GRPO 中重要性采样(Importance Sampling)的启发,作者设计了一个优势加权的注意力散度损失(Advantage-Weighted Attention Divergence):

•

$A_t$:序列级别的优势(Advantage),也就是这个回答相对于平均水平好多少。

•

$D(cdot)$:散度度量,作者选用了 Jensen-Shannon Divergence (JSD)。

为什么要用 JSD?

JSD 是对称且有界的。它的性质非常适合用来做这种正则化:

•

当 $A_t > 0$(好结果)时:我们要最小化 Loss。因为 A_t 是正数,所以我们要最小化 $D(p_theta^t parallel p_{old}^t)$。这意味着让当前的策略($p_theta$)靠近那个产生了高分的旧策略($p_{old}$)。这叫“巩固成功经验”。

•

当 $A_t < 0$(差结果)时:$A_t$ 是负数。最小化整体 Loss 实际上是在最大化 $D(p_theta^t parallel p_{old}^t)$(因为负负得正)。这意味着让当前策略远离那个导致低分的旧策略。这叫“吸取失败教训”。

数学背后的直觉:

•

当 $A_tau > 0$(成功):梯度更新会最小化散度,让模型“记住”这次成功的注意力模式。

•

当 $A_tau < 0$(失败):梯度更新会最大化散度,迫使模型去“探索”其他的注意力片段,惩罚导致低分的推理路径。

这种Per-token(逐个 Token) 的细粒度监督非常关键。它避免了长序列中直接平均注意力带来的“梯度消失”问题,确保即使是回答末尾的 Token,它的注意力行为也能受到精确的指导。

3.3. Combined Optimization Objective

最终的训练目标,是把传统的“说对词”(Token Policy)和新的“看对地”(Attention Policy)结合起来:

•

$\mathcal{L}_{RL}$:负责显式地最大化输出回报(让答案对)。

•

$\mathcal{L}_{AttnRL}$:作为一个结构化正则项(Structural Regularizer),负责规范内部的推理过程(让关注点对)。

\lambda_{attn} 是一个超参数,用来平衡这两者。这就像是老师教学生:既要看你最后答案写没写对,也要看你解题过程中的草稿纸上是不是画对了重点。

3.4. Gradient Derivation

这一节深入到了数学推导的深水区,展示了如何通过链式法则计算 \mathcal{L}_{AttnRL} 对注意力 Logits e_{t,i} 的梯度。

令 $J_t = text{JSD}(p_theta^t parallel p_{old}^t)$,推导分为三步走:

1. Gradient w.r.t. Distribution(关于分布的梯度)

首先计算 JSD 对当前分布 p_\theta^t 的偏导数:

2. Gradient w.r.t. Logits(关于 Logits 的梯度)

接着,利用 Softmax 的雅可比矩阵 $frac{partial p_j}{partial e_i} = p_i(delta_{ij} - p_j)$,计算特定 Logit e_{t,i} 的梯度:

这一步将分布层面的变化传回到了未归一化的 Logits 层面。

3. Total Parameter Update(总参数更新)

最后,注意力损失对模型参数 \theta 的最终梯度,是整个序列上优势加权(Advantage-weighted) 的累积:

3.5. On-Policy Attention Distillation

RAL 的框架不仅可以用于纯 RL 探索,还可以扩展到蒸馏(Distillation) 场景。

这里设定的场景是:我们有一个更强的教师模型(Teacher, $pi_phi$),希望学生模型(Student, $pi_theta$) 不仅模仿老师的答案,还要模仿老师的“眼神”。

Teacher-Student Alignment(师生对齐)

在学生模型自己生成的轨迹 \tau \sim \pi_\theta 上(注意是 On-policy 的,不是把老师的轨迹喂给学生),我们计算两者注意力分布的距离:

注意这里没有 Advantage 项($A_t$)

在蒸馏任务中,目标是纯粹的结构模仿(Pure Structural Imitation)。

不管结果好坏,学生都要尽可能模仿老师在当前上下文下的注意力分布。这提供了比单纯的 Token 级 KL 散度更稠密(Dense) 的梯度信号。

Unified Distillation Objective(统一蒸馏目标)

将所有东西放在一起,就得到了 On-policy 蒸馏的终极 Loss:

•

$mathcal{L}_{RL}$:通过环境奖励学习(自我探索)。

•

$mathcal{L}_{GKD}$:Generalized Knowledge Distillation,模仿老师的输出 Logits(言传)。

•

$mathcal{L}_{AttnDistill}$:模仿老师的注意力分布(身教)。

Gradient Flow(梯度流)

\mathcal{L}_{AttnDistill} 对学生模型参数 \theta 的梯度推导与 3.4 节类似,但目标纯粹是向教师的分布对齐:

其中 $J_t = text{JSD}(p_theta^t parallel p_phi^t)$。

通过在学生生成的轨迹($tau sim pi_theta$)上采样,模型学会了即使在面对它自己产生的(可能不完美的)状态时,依然保持“像老师一样”的注意力模式。这种机制有效地缓解了传统离线蒸馏中的 Exposure Bias(暴露偏差),确保存储在内部表示中的推理行为具有更好的鲁棒性。

本章小结

这一章是全文的理论核心。作者通过数学推导,构建了一套完整的“注意力强化学习”框架。

1.

定义策略:将 Attention Map 视为策略。

2.

定义奖励:利用 Advantage 加权的 JSD 散度,奖励好的注意力,惩罚坏的注意力。

3.

扩展应用:将这一思想无缝迁移到 On-policy 蒸馏中,实现了“言传身教”的双重监督。

这套方法的精髓在于,它不再把 Transformer 内部的 Attention 当作不可解释的黑盒,而是将其视为可以被 RL 信号直接整形的“感知行为”。

4. Experiments

既然提出了“直接优化注意力”这个直击本质的想法,那它的实际效果到底如何?在这一章,作者通过一系列详尽的实验,全方位地验证了 RAL 的有效性。从基础的模型配置,到横跨图像与视频的 15 个基准测试,再到剥离思维链的消融研究,本章用扎实的数据回答了一个核心问题:机器的“眼神”真的比“嘴巴”更重要吗?

4.1. Experimental Setup

实验的基础设施是验证理论的基石。作者选择了 Qwen-2.5-VL 系列作为基础模型。

•

Foundation Model(基础模型):采用 Qwen-2.5-VL-7B。

•

Teacher Model(教师模型):在 On-policy Attention Distillation 实验中,使用参数量更大的 Qwen-2.5-VL-32B 作为老师。

训练流程分为两个主要阶段,使用了 VIDEO-R1 数据集,并基于 veRL 框架实现:

1.

Supervised Fine-Tuning (SFT):

为了让模型学会基本的推理格式,作者使用 VIDEO-R1-COT-165k 子集进行微调。这个数据集包含了视频问答对以及结构化的 Chain-of-Thought (CoT) 推理。

格式遵循:<think>推理过程...</think><answer>最终答案</answer>。

这一步大概在 8 张 H100 上跑了 10 个小时。

2.

Reinforcement Learning (RL):

这是重头戏。作者从 VIDEO-R1-260k 数据集中采样了前 51.2k 个实例进行单个 epoch 的训练。

对于每个输入,策略(Policy)会生成 $G=8$ 个 Rollouts(采样轨迹) 来估计优势(Advantage)。

这一步计算量较大,在 8 张 H100 上跑了约 120 小时。

4.2. Implementation Details

为了确保实验的可复现性,作者公布了详细的实现细节。

Visual Processing(视觉处理)

•

图像分辨率:最大 $5120 times 28 times 28$ 像素,最小 $128 times 28 times 28$ 像素。

•

视频采样:以 1fps(每秒一帧)采样,总帧数上限为 128 帧。

Hyperparameters(超参数)

•

Attention Weights Extraction:作者通过 Patch 注意力实现,提取了 Last Transformer Layer(最后一层) 的注意力权重,并对所有 Head 进行了平均。

•

RL 设置:采样温度 $tau = 0.9$,KL 系数 $beta = 0.04$。

•

学习率:SFT 阶段为 $5 times 10^{-6}$,RL 阶段为 $1 times 10^{-5}$。

Baselines(基线对比)

为了公平对比,作者主要选择了 Group Relative Policy Optimization (GRPO) 作为对手。

GRPO 的核心优势在于不需要额外的 Value Model,直接通过一组输出的相对好坏来计算 Advantage。

奖励函数(Reward Function)由两部分组成:

1.

Accuracy Reward ($r_{acc}$):答案对不对?(完全匹配得 1.0,否则 0.0)

2.

Format Reward ($r_{fmt}$):格式对不对?(是否严格遵循 <think>...</think><answer>...</answer> 模板)

最终奖励 $r_i = 0.9 cdot r_{acc} + 0.1 cdot r_{fmt}$。这意味着准确率才是硬道理。

4.3. Evaluation Benchmarks

为了证明 RAL 不是“偏科生”,作者在极广泛的视觉基准上进行了评估,涵盖了空间理解、时间推理和复杂认知能力。

•

Image QA Tasks(8 个基准):

◦

$V^*$ Bench:细粒度视觉搜索。

◦

MMMU Pro:专家级多步推理。

◦

VizWiz:真实场景视觉 Grounding。

◦

其他包括 MME、MuirBench、ChartQA、Blink、CVBench。

•

Video QA Tasks(7 个基准):

◦

LongVideoBench:长视频推理。

◦

NExT-QA:因果和时序动作解释。

◦

Video-MME:多领域综合评估。

◦

其他包括 Video-MMMU、LVBench、MVBench、TempCompass。

4.4. Main Results

实验结果非常令人振奋。RAL 几乎是全面碾压了 GRPO 和基础模型。

Video QA Results(视频问答结果)

在长视频基准上,RAL 在 7 个数据集中的 6 个上击败了 GRPO。

•

LongVideoBench (+2.2%)、NExT-QA (+3.4%)、MVBench (+1.5%):这些显著的提升表明,优化注意力能极大增强模型在长时序理解和多跳推理上的稳健性。

•

GRPO 仅在 Video-MMMU 上保持微弱优势,这说明 RAL 在追求“看清楚”的同时,并没有牺牲领域特定的事实准确性。

Image QA Results(图像问答结果)

在图像领域,RAL 的优势更加明显,在所有 8 个基准上全部超越 GRPO。

🌟 关键胜出点

•

MME (+94.1):这是非常惊人的提升,表明感知和认知能力的大幅跃升。

•

VizWiz (+3.8) & $V^*$ (+5.8):这两个基准非常看重Visual Grounding(视觉定位)。这直接验证了 RAL 的核心假设:更好的注意力分布 = 更精准的视觉定位。

此外,On-Policy Attention Distillation 也表现出色,在绝大多数基准上都优于普通的 Logits 蒸馏,进一步证明了“教学生怎么看”比“教学生怎么说”更有效。

4.5. Ablation Studies

为了深入探究 RAL 的生效机制,作者进行了两项关键的消融实验。

1. Robustness across resolutions and frame rates(分辨率与帧率的鲁棒性)

作者在 LongVideoBench(不同帧数)和 $V^*$(不同 Token 数/分辨率)上测试了模型表现。

结论:越复杂,越能打。

随着图像分辨率的提高(从 512 tokens 到 2048 tokens),RAL 相对于 GRPO 的优势从 +1.6 扩大到了 +6.3。

这说明:视觉信息越密集、越细粒度,RAL 这种“基于注意力的策略”就越能体现出筛选关键信息的优势。

2. Is an Explicit Thinking Process Necessary?(显式的思维过程是必须的吗?)

这是一个非常有趣的灵魂发问。如果去掉了 <think> 标签,不让模型“碎碎念”,RAL 还有用吗?

作者训练了一个 RAL-zero 变体:从 SFT 到 RL 阶段,完全移除思维链,让模型直接输出答案。

结果令人大跌眼镜:

RAL-zero 依然在大杀四方。

•

在视频任务上,它在 NExTQA、VideoMME 和 LVBench 上甚至达到了 State-of-the-Art (SOTA)。

•

在图像任务上,它在 MMMU-Pro 和 VizWiz 上取得了最高分。

💡 深度解读:为什么 RAL-zero 这么强?

这说明了一个极其重要的事实:对于视觉理解任务,显式的语言逻辑(Verbalized Logic)可能并不是必须的。

通过直接优化底层的注意力分布,我们其实是在构建一座隐式的跨模态桥梁。模型不需要把“我在看左下角”这句话说出来,它只要真的“盯着左下角看”,就能把题做对。

这有力地回击了“万物皆 CoT”的盲目跟风,证明了在感知密集型任务中,Internal Attention Optimization(内部注意力优化) 可能比 Token-level Reasoning(Token 级推理) 更接近本质。

本章小结

本章的实验结果不仅验证了 RAL 在性能上的优越性,更重要的是通过 RAL-zero 揭示了多模态感知的另一种可能性:去 CoT 化。数据表明,直接对齐注意力分布是一种比传统 RLHF 更稳定、更泛化、且更能挖掘模型视觉潜力的训练范式。

5. Conclusion

本文正式提出了 Reinforced Attention Learning (RAL),这是一种针对 MLLM 后训练的全新范式。

它的核心变革在于:将优化的主战场从“文本 Token 分布”转移到了“内部注意力分布”。

通过将 Attention 视为一种策略(Policy),RAL 直接对Visual Grounding(视觉落地) 和 Perceptual Focus(感知聚焦) 进行强化。

这解决了传统基于结果的 RL(Outcome-based RL)的一个根本性缺陷:它们只在乎结果对不对,却忽略了跨模态推理的过程是否合理。

核心结论回顾

•

更稳健的提升:在广泛的图像和长视频基准测试中,RAL 持续击败基础模型和 GRPO。它提供的增益比 Token 级 RL 更稳定、更均匀,避免了后者偶尔出现的“为了做题而做题”导致的性能退化。

•

更本质的信号:实验结果验证了一个假设——监督内部的信息分配(Information Allocation)比单纯的 Next-token 梯度能提供更可靠、更可泛化的训练信号。

•

更高效的蒸馏:在 On-policy 蒸馏场景下,传递“看哪里”(Where to focus)这一知识,提供了一种互补且语义丰富的信号,远超简单的输出模仿。

最终,这项工作确立了 Attention Distributions(注意力分布) 作为多模态对齐中一等公民(First-class Optimization Target) 的地位。

RAL 提供了一种有原则的、Process-aware(感知过程的) 替代方案,来升级标准的 RLHF。

作者相信,这一视角将为未来的研究铺平道路,特别是在细粒度信用分配(Fine-grained Credit Assignment) 以及优化其他内部结构(如 MoE 路由或跨模态融合)方面,从而培养出更健壮、更脚踏实地的多模态智能。

写在最后

读完这篇论文,最让我感触的不是某个具体的数学公式,而是它对 “感知(Perception)”与“推理(Reasoning)” 这两者关系的重新审视。

在 LLM 时代,我们习惯了用 Chain-of-Thought (CoT) 去解决所有问题,仿佛只要让模型“多说几句”,它就能变聪明。但这篇文章用扎实的实验告诉我们:对于视觉感知任务,语言可能是一种累赘。

Reinforced Attention Learning (RAL) 的美感在于它回归了感知的本源。

当我们人类在看图找茬时,我们的大脑并不是在疯狂地自言自语,而是在快速地扫描、聚焦、比对。RAL 正是试图让模型通过 RL 习得这种隐式的、非语言的感知策略。

这给我们带来了几点深刻的启示:

1.

打开黑盒:强化学习不应该只停留在输出层。Transformer 内部丰富的中间状态(Attention, Activations)其实蕴含着巨大的可优化空间。

2.

去伪存真:在多模态领域,不要盲目迷信 CoT。有时候,“沉默的注视”比“喧闹的分析”更有力量。

3.

对齐的维度:真正的对齐,不仅是输出结果的对齐,更是思维过程(Attention Pattern)的对齐。

DeepMind 的这项工作,或许标志着多模态后训练正在从粗放的“结果导向”迈向精细的“过程导向”。未来的 Agent,不仅要能说会道,更要有一双由于经受过强化训练而变得“目光如炬”的眼睛。

Reinforced Attention Learning 由 UC Davis、Princeton、Google 和 Google DeepMind 的研究员联合发表于 2026 年 2 月。

我们都知道,在大语言模型(LLM)时代,强化学习后训练(Post-training with RL) 是提升模型推理能力的关键技术,尤其是通过 Test-time scaling(测试时计算扩展),让模型“多想一会儿”,效果显著。自然地,大家也想把这套逻辑搬到多模态大模型(MLLMs)上,让模型在回答视觉问题前先生成一大段“思维链(CoT)”。

但作者敏锐地发现了一个问题:对于需要细腻感知的视觉任务,这种“长篇大论”的推理不仅收益微薄,甚至可能适得其反。

针对这一痛点,本文提出了一个非常底层的创新视角:Reinforced Attention Learning (RAL)。与其像传统 RL 那样优化“输出什么词”(what to generate),不如直接优化模型内部“关注哪里”(where to attend)。他们将 Transformer 内部的注意力分布(Attention Distribution) 直接视为优化的策略(Policy),让模型在奖励信号的驱动下,学会更精准地聚焦于图像或视频中的关键区域。

这篇论文的思路非常清奇且直击本质。它跳出了“Next-token Prediction”的桎梏,试图通过显式地修正注意力模式来增强模型的 Grounding(落地/对齐)能力。实验证明,这种方法在视频和图像问答任务上,比现在的当红炸子鸡 GRPO 还要好。

1. Introduction

在这一章,作者首先指出了将 LLM 的推理范式直接迁移到多模态领域的局限性,并一针见血地分析了原因:感知任务的核心在于“看对地方”,而非“多说话”。基于此,作者引出了本文的核心方法论——将优化目标从 Token 转移到 Attention。

我们见证了 LLM 在数学和编程等复杂领域的惊人表现,这很大程度上归功于大规模无监督预训练和随后的强化学习后训练(Post-training with RL)。

目前的各种 Post-training 方法,本质上都是利用奖励信号来优化模型的策略,鼓励模型生成高价值的 Token 序列。

从本质上讲,这些策略梯度方法(Policy Gradient Methods)是在微调 Next-token Distribution(下一个词的概率分布),以最大化期望奖励。

最近的研究更是强调了“推理长度”与“任务准确率”之间的强相关性,这就是大家津津乐道的 Test-time Scaling。

为了将这种红利扩展到 多模态大模型(MLLMs),很多人尝试在 视觉问答(VQA) 任务中引入“思考过程”。也就是让模型在给出最终答案之前,先生成一段详尽的视觉描述作为思维链(CoT)。

❓ 为什么 LLM 的 CoT 经验在多模态感知任务上失效了?

作者发现,虽然在逻辑推理任务上 CoT 很有效,但对于核心感知任务(Core Perception Tasks)——比如图像或视频问答——通过生成大量文本来进行推理,收益非常有限,甚至会因为“幻觉”或“跑题”导致性能下降。

这就好比你问一个人“图里这只鸟是什么品种”,他如果开始长篇大论地分析鸟类进化的历史,反而容易忽略图里那只鸟嘴巴的细节特征。感知需要的是“精准的注视”,而不是“冗长的陈述”。

作者认为,这个问题的根源在于:

Next-token Prediction(下一个词预测)作为 MLLM 后训练的基础策略目标,可能是不够的。

在典型的 MLLM 架构中,视觉输入被编码成 Token,投射到文本嵌入空间中。要准确回答细粒度的问题,模型必须精确地识别并关注与任务相关的视觉信息。这个过程是由 Transformer 的注意力机制(Attention Mechanism) 主导的,它决定了给哪些 Token 分配更高的权重。

然而,标准的 RLHF(基于人类反馈的强化学习) 优化的是结果(Token),而不是过程(内部的信息分配)。

受到这一观察的启发,作者提出重新制定 MLLM 的后训练策略,让它直接作用于生成过程中的注意力分布(Attention Distribution)。这就是本文提出的 Reinforced Attention Learning (RAL)。

RAL 旨在优化模型,使其产生高效用的注意力轨迹。与传统方法不同,RAL 将注意力模式本身视为策略(Policy):

•

当一个回答获得高奖励时,算法会通过最小化当前策略与参考策略(Reference Policy)之间的散度,来鼓励这种底层的注意力分布。

•

反之,对于低奖励的回答,模型会通过增加散度来受到惩罚,从而远离那些次优的注意力模式。

通过将优化目标从“Token 似然度”转移到“基于注意力的分配”,RAL 能更直接地对 MLLM 进行多模态对齐微调。实验表明,RAL 在视频和图像基准测试上始终优于 GRPO (Group Relative Policy Optimization),特别是在那些感知密集型的任务上。

💡 核心洞察:RAL 的本质是什么?

RAL 的本质是一次优化对象的降维打击。

传统的 RLHF 是在说:“只要你说出了正确的答案,我就给你糖吃。”(结果导向,What to generate)

RAL 是在说:“我看你刚才盯着图像的左上角看,然后答对了,这很好,下次继续盯着这儿看。”(过程导向,Where to focus)

它试图通过奖励信号,去反向修正模型内部“看东西”的习惯,让模型探索出一种高效的“信息收集策略”(Information-gathering Policy)。

此外,优化注意力分布的有效性还可以自然地延伸到 On-Policy Distillation(在线策略蒸馏)。传统的蒸馏侧重于 Token 级别的概率对齐,而作者提出了一种双重蒸馏方法(Dual-distillation),即同时进行 Token 对齐和注意力分布对齐。实验表明,加入注意力蒸馏能带来显著的额外性能提升。

总结一下,本文的主要贡献如下:

1.

Reinforced Attention Learning (RAL):提出了一种策略梯度方法,将优化目标从 Next-token Prediction 转移到 Attention-distribution Alignment(注意力分布对齐),从而通过直接强化视觉 Grounding,而不是通过文本输出进行间接监督。

2.

On-Policy Attention Distillation:将框架扩展到在线策略蒸馏设置,显著提高了学生模型从教师模型继承细粒度感知和 Grounding 行为的能力。

3.

实证验证(Empirical Validation):大量实验证明,在需要细粒度视觉理解和感知的各类 VQA 基准上,RAL 的表现持续优于 GRPO。

本章小结

第一章清晰地界定了研究动机:多模态模型在感知任务上不能简单照搬文本模型的 CoT 策略。作者指出,问题的症结在于现有的优化手段(Next-token Prediction)无法直接触达感知的核心机制——注意力。因此,本文提出了 RAL,旨在直接利用 RL 信号去“修剪”和“塑造”模型的注意力分布,使其学会像人类一样在感知时“聚焦重点”。

2. Related Works

在这一章,我们来梳理一下 RAL 的技术坐标系。作者回顾了 LLM 强化学习后训练的发展脉络,以及知识蒸馏技术的演进,从而更清晰地定位了 RAL 在这两个领域交叉点上的独特价值。

2.1. Post training LLMs through Reinforcement Learning(通过强化学习进行 LLM 后训练)

现在,后训练(Post-training) 已经成为让 LLM 对齐人类意图的标准操作。

经典的 RLHF(Reinforcement Learning from Human Feedback) 流程大家都很熟悉了:先做 SFT(有监督微调),再训练一个 RM(奖励模型) 来模拟人类偏好,最后通过 RL 算法(如 PPO)来优化策略。

然而,当我们将这套逻辑搬到 多模态 LLM(MLLMs) 时,遇到了新问题:幻觉(Hallucination) 和 跨模态 Grounding(对齐/落地) 的缺失。

作者特别提到了一个顽疾:模态偏差(Modality Bias)。

•

有时候,模型太依赖语言先验(Linguistic Priors),看都不看图就瞎猜;

•

有时候,模型又过度拟合于肤浅的视觉线索(Superficial Visual Cues)。

现有的很多工作试图通过设计复杂的奖励函数来惩罚这些“走捷径”的行为。但本文作者认为,与其在奖励函数上打补丁,不如从源头解决问题:

利用 Attention 这一根本的信息选择机制。

既然跨模态推理依赖于识别关键证据,那么直接控制注意力权重(Attention Weights),显然比仅仅控制输出的文本 Token 要更本质、更符合第一性原理。

2.2. Distilling knowledge and beyond from teacher to student models(从教师到学生的知识蒸馏及超越)

知识蒸馏(Knowledge Distillation, KD) 的核心思想是让“学生模型”模仿“教师模型”。

传统的 KD 通常是让学生去匹配教师输出的软概率分布(Softened Output Distributions),而不是硬标签。这在模型压缩和领域适配中非常有用。在大模型时代,蒸馏的对象也从 Output Logits 扩展到了中间层表示、Attention Map 等。

进阶玩法:On-policy Distillation(在线策略蒸馏)

最近的研究开始探索 On-policy Distillation。

与传统在静态数据集上进行的离线 KD 不同,On-policy 蒸馏是让 学生模型自己生成回答(Under its own policy),然后由教师模型对这些生成的轨迹进行评估和指导。

为什么要这么做?

因为它能缓解“暴露偏差”(Exposure Bias)——即训练时老师教的是标准答案,测试时学生自己写可能会跑偏。让学生在训练时就“自己写、老师改”,能更好地对齐测试时的行为,同时保持监督学习的稳定性。

在本文中,作者将这一理念推向了新的高度:On-policy Attention Distillation。

这不仅仅是让学生模仿老师的答案(Token),更是在 On-policy 的框架下,让学生模仿老师“思考时的目光”(Attention Distribution)。这就为学生模型提供了一种原则性的结构化正则(Structural Regularization),确保学生不仅答对了,而且是因为“看懂了”才答对的。

本章小结

这一章为 RAL 奠定了理论基础:它继承了 GRPO 的高效 RL 思想,但解决了其在多模态感知上的不足;它借鉴了 On-policy Distillation 的先进范式,但引入了独特的 Attention 维度监督。作者通过对现有工作的梳理,指出了“Token 级优化”在多模态对齐上的局限性,从而突显了“直接优化 Attention”的必要性。

3. Reinforced Attention Learning

在这一章,作者正式端出了主菜——Reinforced Attention Learning (RAL) 的数学形式化描述。这一章的核心在于回答一个问题:如果我们不只盯着“输出结果”(Token),而是盯着“思维过程”(Attention),强化学习的目标函数该长什么样?作者在这里推导了一套基于注意力分布的策略梯度算法,并将其进一步扩展到了在线蒸馏(On-Policy Distillation)场景。

3.1. Aggregated causal Attention Distribution Policy

我们先来看看传统的 LLM 强化学习是怎么做的。通常,PPO 或 GRPO 这样的算法优化的是输出 Token 分布上的期望回报。公式通常长这样:

这里的 A_t 是优势函数(Advantage)。这个公式直白地说就是:如果一个动作(生成的词)带来了正向的回报,就提高它出现的概率;反之则降低。

传统 Token 级优化的隐患:Diversity Collapse(多样性坍缩)

作者指出,显式地优化 Token 分布的差异(Divergence)虽然能提高即时奖励,但往往会导致模型过度拟合到特定的高分句式或表面形式。

这就是所谓的“Reward Hacking”——模型学会了套话、废话,而不是学会了真正的推理逻辑。这就像一个学生为了拿高分,死记硬背标准答案的“解题套路”,而不是真正理解了题目。

为了缓解这个问题,作者提出:

将优化目标从外部的输出分布(Output Distribution)转移到内部的注意力分布(Internal Attention Distribution)。

作者认为:

模型的内部注意力机制构成了一个替代的、潜在的策略空间(Latent Policy Space)。

具体定义如下:

假设生成的序列是 $S = (x_1, ..., x_T)$,其中 x_1...x_P 是提示词(Prompt),$x_{P+1}...x_T$ 是生成的回答。

对于每一个生成的 Token $t$,我们定义它的因果注意力分布策略(Causal Attention Distribution Policy)p_\theta^t 为它对所有前序位置 i 的关注度:

这里 \alpha_{t,i} 是从最后一层提取并对所有注意力头取平均后的注意力权重。

为什么要对所有 Head 取平均?

Transformer 有很多层,每层有很多头(Head)。作者在这里做了一个简化处理:取最后一层(Final Layer),并对所有头取平均。

这背后的直觉是:最后一层通常汇聚了最高层的语义信息和推理结果,而平均化则提取了一种“全局的关注倾向”,忽略掉个别 Head 的特异性功能,从而将注意力模式抽象为一个统一的“信息收集策略”。

3.2. Advantage-Weighted Attention Divergence

定义好了“注意力策略”,接下来就要设计 Loss 函数了。

作者的目标是:让高奖励的回复对应的注意力模式被保留和增强。

受 PPO/GRPO 中重要性采样(Importance Sampling)的启发,作者设计了一个优势加权的注意力散度损失(Advantage-Weighted Attention Divergence):

•

$A_t$:序列级别的优势(Advantage),也就是这个回答相对于平均水平好多少。

•

$D(cdot)$:散度度量,作者选用了 Jensen-Shannon Divergence (JSD)。

为什么要用 JSD?

JSD 是对称且有界的。它的性质非常适合用来做这种正则化:

•

当 $A_t > 0$(好结果)时:我们要最小化 Loss。因为 A_t 是正数,所以我们要最小化 $D(p_theta^t parallel p_{old}^t)$。这意味着让当前的策略($p_theta$)靠近那个产生了高分的旧策略($p_{old}$)。这叫“巩固成功经验”。

•

当 $A_t < 0$(差结果)时:$A_t$ 是负数。最小化整体 Loss 实际上是在最大化 $D(p_theta^t parallel p_{old}^t)$(因为负负得正)。这意味着让当前策略远离那个导致低分的旧策略。这叫“吸取失败教训”。

数学背后的直觉:

•

当 $A_tau > 0$(成功):梯度更新会最小化散度,让模型“记住”这次成功的注意力模式。

•

当 $A_tau < 0$(失败):梯度更新会最大化散度,迫使模型去“探索”其他的注意力片段,惩罚导致低分的推理路径。

这种Per-token(逐个 Token) 的细粒度监督非常关键。它避免了长序列中直接平均注意力带来的“梯度消失”问题,确保即使是回答末尾的 Token,它的注意力行为也能受到精确的指导。

3.3. Combined Optimization Objective

最终的训练目标,是把传统的“说对词”(Token Policy)和新的“看对地”(Attention Policy)结合起来:

•

$\mathcal{L}_{RL}$:负责显式地最大化输出回报(让答案对)。

•

$\mathcal{L}_{AttnRL}$:作为一个结构化正则项(Structural Regularizer),负责规范内部的推理过程(让关注点对)。

\lambda_{attn} 是一个超参数,用来平衡这两者。这就像是老师教学生:既要看你最后答案写没写对,也要看你解题过程中的草稿纸上是不是画对了重点。

3.4. Gradient Derivation

这一节深入到了数学推导的深水区,展示了如何通过链式法则计算 \mathcal{L}_{AttnRL} 对注意力 Logits e_{t,i} 的梯度。

令 $J_t = text{JSD}(p_theta^t parallel p_{old}^t)$,推导分为三步走:

1. Gradient w.r.t. Distribution(关于分布的梯度)

首先计算 JSD 对当前分布 p_\theta^t 的偏导数:

2. Gradient w.r.t. Logits(关于 Logits 的梯度)

接着,利用 Softmax 的雅可比矩阵 $frac{partial p_j}{partial e_i} = p_i(delta_{ij} - p_j)$,计算特定 Logit e_{t,i} 的梯度:

这一步将分布层面的变化传回到了未归一化的 Logits 层面。

3. Total Parameter Update(总参数更新)

最后,注意力损失对模型参数 \theta 的最终梯度,是整个序列上优势加权(Advantage-weighted) 的累积:

3.5. On-Policy Attention Distillation

RAL 的框架不仅可以用于纯 RL 探索,还可以扩展到蒸馏(Distillation) 场景。

这里设定的场景是:我们有一个更强的教师模型(Teacher, $pi_phi$),希望学生模型(Student, $pi_theta$) 不仅模仿老师的答案,还要模仿老师的“眼神”。

Teacher-Student Alignment(师生对齐)

在学生模型自己生成的轨迹 \tau \sim \pi_\theta 上(注意是 On-policy 的,不是把老师的轨迹喂给学生),我们计算两者注意力分布的距离:

注意这里没有 Advantage 项($A_t$)

在蒸馏任务中,目标是纯粹的结构模仿(Pure Structural Imitation)。

不管结果好坏,学生都要尽可能模仿老师在当前上下文下的注意力分布。这提供了比单纯的 Token 级 KL 散度更稠密(Dense) 的梯度信号。

Unified Distillation Objective(统一蒸馏目标)

将所有东西放在一起,就得到了 On-policy 蒸馏的终极 Loss:

•

$mathcal{L}_{RL}$:通过环境奖励学习(自我探索)。

•

$mathcal{L}_{GKD}$:Generalized Knowledge Distillation,模仿老师的输出 Logits(言传)。

•

$mathcal{L}_{AttnDistill}$:模仿老师的注意力分布(身教)。

Gradient Flow(梯度流)

\mathcal{L}_{AttnDistill} 对学生模型参数 \theta 的梯度推导与 3.4 节类似,但目标纯粹是向教师的分布对齐:

其中 $J_t = text{JSD}(p_theta^t parallel p_phi^t)$。

通过在学生生成的轨迹($tau sim pi_theta$)上采样,模型学会了即使在面对它自己产生的(可能不完美的)状态时,依然保持“像老师一样”的注意力模式。这种机制有效地缓解了传统离线蒸馏中的 Exposure Bias(暴露偏差),确保存储在内部表示中的推理行为具有更好的鲁棒性。

本章小结

这一章是全文的理论核心。作者通过数学推导,构建了一套完整的“注意力强化学习”框架。

1.

定义策略:将 Attention Map 视为策略。

2.

定义奖励:利用 Advantage 加权的 JSD 散度,奖励好的注意力,惩罚坏的注意力。

3.

扩展应用:将这一思想无缝迁移到 On-policy 蒸馏中,实现了“言传身教”的双重监督。

这套方法的精髓在于,它不再把 Transformer 内部的 Attention 当作不可解释的黑盒,而是将其视为可以被 RL 信号直接整形的“感知行为”。

4. Experiments

既然提出了“直接优化注意力”这个直击本质的想法,那它的实际效果到底如何?在这一章,作者通过一系列详尽的实验,全方位地验证了 RAL 的有效性。从基础的模型配置,到横跨图像与视频的 15 个基准测试,再到剥离思维链的消融研究,本章用扎实的数据回答了一个核心问题:机器的“眼神”真的比“嘴巴”更重要吗?

4.1. Experimental Setup

实验的基础设施是验证理论的基石。作者选择了 Qwen-2.5-VL 系列作为基础模型。

•

Foundation Model(基础模型):采用 Qwen-2.5-VL-7B。

•

Teacher Model(教师模型):在 On-policy Attention Distillation 实验中,使用参数量更大的 Qwen-2.5-VL-32B 作为老师。

训练流程分为两个主要阶段,使用了 VIDEO-R1 数据集,并基于 veRL 框架实现:

1.

Supervised Fine-Tuning (SFT):

为了让模型学会基本的推理格式,作者使用 VIDEO-R1-COT-165k 子集进行微调。这个数据集包含了视频问答对以及结构化的 Chain-of-Thought (CoT) 推理。

格式遵循:<think>推理过程...</think><answer>最终答案</answer>。

这一步大概在 8 张 H100 上跑了 10 个小时。

2.

Reinforcement Learning (RL):

这是重头戏。作者从 VIDEO-R1-260k 数据集中采样了前 51.2k 个实例进行单个 epoch 的训练。

对于每个输入,策略(Policy)会生成 $G=8$ 个 Rollouts(采样轨迹) 来估计优势(Advantage)。

这一步计算量较大,在 8 张 H100 上跑了约 120 小时。

4.2. Implementation Details

为了确保实验的可复现性,作者公布了详细的实现细节。

Visual Processing(视觉处理)

•

图像分辨率:最大 $5120 times 28 times 28$ 像素,最小 $128 times 28 times 28$ 像素。

•

视频采样:以 1fps(每秒一帧)采样,总帧数上限为 128 帧。

Hyperparameters(超参数)

•

Attention Weights Extraction:作者通过 Patch 注意力实现,提取了 Last Transformer Layer(最后一层) 的注意力权重,并对所有 Head 进行了平均。

•

RL 设置:采样温度 $tau = 0.9$,KL 系数 $beta = 0.04$。

•

学习率:SFT 阶段为 $5 times 10^{-6}$,RL 阶段为 $1 times 10^{-5}$。

Baselines(基线对比)

为了公平对比,作者主要选择了 Group Relative Policy Optimization (GRPO) 作为对手。

GRPO 的核心优势在于不需要额外的 Value Model,直接通过一组输出的相对好坏来计算 Advantage。

奖励函数(Reward Function)由两部分组成:

1.

Accuracy Reward ($r_{acc}$):答案对不对?(完全匹配得 1.0,否则 0.0)

2.

Format Reward ($r_{fmt}$):格式对不对?(是否严格遵循 <think>...</think><answer>...</answer> 模板)

最终奖励 $r_i = 0.9 cdot r_{acc} + 0.1 cdot r_{fmt}$。这意味着准确率才是硬道理。

4.3. Evaluation Benchmarks

为了证明 RAL 不是“偏科生”,作者在极广泛的视觉基准上进行了评估,涵盖了空间理解、时间推理和复杂认知能力。

•

Image QA Tasks(8 个基准):

◦

$V^*$ Bench:细粒度视觉搜索。

◦

MMMU Pro:专家级多步推理。

◦

VizWiz:真实场景视觉 Grounding。

◦

其他包括 MME、MuirBench、ChartQA、Blink、CVBench。

•

Video QA Tasks(7 个基准):

◦

LongVideoBench:长视频推理。

◦

NExT-QA:因果和时序动作解释。

◦

Video-MME:多领域综合评估。

◦

其他包括 Video-MMMU、LVBench、MVBench、TempCompass。

4.4. Main Results

实验结果非常令人振奋。RAL 几乎是全面碾压了 GRPO 和基础模型。

Video QA Results(视频问答结果)

在长视频基准上,RAL 在 7 个数据集中的 6 个上击败了 GRPO。

•

LongVideoBench (+2.2%)、NExT-QA (+3.4%)、MVBench (+1.5%):这些显著的提升表明,优化注意力能极大增强模型在长时序理解和多跳推理上的稳健性。

•

GRPO 仅在 Video-MMMU 上保持微弱优势,这说明 RAL 在追求“看清楚”的同时,并没有牺牲领域特定的事实准确性。

Image QA Results(图像问答结果)

在图像领域,RAL 的优势更加明显,在所有 8 个基准上全部超越 GRPO。

🌟 关键胜出点

•

MME (+94.1):这是非常惊人的提升,表明感知和认知能力的大幅跃升。

•

VizWiz (+3.8) & $V^*$ (+5.8):这两个基准非常看重Visual Grounding(视觉定位)。这直接验证了 RAL 的核心假设:更好的注意力分布 = 更精准的视觉定位。

此外,On-Policy Attention Distillation 也表现出色,在绝大多数基准上都优于普通的 Logits 蒸馏,进一步证明了“教学生怎么看”比“教学生怎么说”更有效。

4.5. Ablation Studies

为了深入探究 RAL 的生效机制,作者进行了两项关键的消融实验。

1. Robustness across resolutions and frame rates(分辨率与帧率的鲁棒性)

作者在 LongVideoBench(不同帧数)和 $V^*$(不同 Token 数/分辨率)上测试了模型表现。

结论:越复杂,越能打。

随着图像分辨率的提高(从 512 tokens 到 2048 tokens),RAL 相对于 GRPO 的优势从 +1.6 扩大到了 +6.3。

这说明:视觉信息越密集、越细粒度,RAL 这种“基于注意力的策略”就越能体现出筛选关键信息的优势。

2. Is an Explicit Thinking Process Necessary?(显式的思维过程是必须的吗?)

这是一个非常有趣的灵魂发问。如果去掉了 <think> 标签,不让模型“碎碎念”,RAL 还有用吗?

作者训练了一个 RAL-zero 变体:从 SFT 到 RL 阶段,完全移除思维链,让模型直接输出答案。

结果令人大跌眼镜:

RAL-zero 依然在大杀四方。

•

在视频任务上,它在 NExTQA、VideoMME 和 LVBench 上甚至达到了 State-of-the-Art (SOTA)。

•

在图像任务上,它在 MMMU-Pro 和 VizWiz 上取得了最高分。

💡 深度解读:为什么 RAL-zero 这么强?

这说明了一个极其重要的事实:对于视觉理解任务,显式的语言逻辑(Verbalized Logic)可能并不是必须的。

通过直接优化底层的注意力分布,我们其实是在构建一座隐式的跨模态桥梁。模型不需要把“我在看左下角”这句话说出来,它只要真的“盯着左下角看”,就能把题做对。

这有力地回击了“万物皆 CoT”的盲目跟风,证明了在感知密集型任务中,Internal Attention Optimization(内部注意力优化) 可能比 Token-level Reasoning(Token 级推理) 更接近本质。

本章小结

本章的实验结果不仅验证了 RAL 在性能上的优越性,更重要的是通过 RAL-zero 揭示了多模态感知的另一种可能性:去 CoT 化。数据表明,直接对齐注意力分布是一种比传统 RLHF 更稳定、更泛化、且更能挖掘模型视觉潜力的训练范式。

5. Conclusion

本文正式提出了 Reinforced Attention Learning (RAL),这是一种针对 MLLM 后训练的全新范式。

它的核心变革在于:将优化的主战场从“文本 Token 分布”转移到了“内部注意力分布”。

通过将 Attention 视为一种策略(Policy),RAL 直接对Visual Grounding(视觉落地) 和 Perceptual Focus(感知聚焦) 进行强化。

这解决了传统基于结果的 RL(Outcome-based RL)的一个根本性缺陷:它们只在乎结果对不对,却忽略了跨模态推理的过程是否合理。

核心结论回顾

•

更稳健的提升:在广泛的图像和长视频基准测试中,RAL 持续击败基础模型和 GRPO。它提供的增益比 Token 级 RL 更稳定、更均匀,避免了后者偶尔出现的“为了做题而做题”导致的性能退化。

•

更本质的信号:实验结果验证了一个假设——监督内部的信息分配(Information Allocation)比单纯的 Next-token 梯度能提供更可靠、更可泛化的训练信号。

•

更高效的蒸馏:在 On-policy 蒸馏场景下,传递“看哪里”(Where to focus)这一知识,提供了一种互补且语义丰富的信号,远超简单的输出模仿。

最终,这项工作确立了 Attention Distributions(注意力分布) 作为多模态对齐中一等公民(First-class Optimization Target) 的地位。

RAL 提供了一种有原则的、Process-aware(感知过程的) 替代方案,来升级标准的 RLHF。

作者相信,这一视角将为未来的研究铺平道路,特别是在细粒度信用分配(Fine-grained Credit Assignment) 以及优化其他内部结构(如 MoE 路由或跨模态融合)方面,从而培养出更健壮、更脚踏实地的多模态智能。

写在最后

读完这篇论文,最让我感触的不是某个具体的数学公式,而是它对 “感知(Perception)”与“推理(Reasoning)” 这两者关系的重新审视。

在 LLM 时代,我们习惯了用 Chain-of-Thought (CoT) 去解决所有问题,仿佛只要让模型“多说几句”,它就能变聪明。但这篇文章用扎实的实验告诉我们:对于视觉感知任务,语言可能是一种累赘。

Reinforced Attention Learning (RAL) 的美感在于它回归了感知的本源。

当我们人类在看图找茬时,我们的大脑并不是在疯狂地自言自语,而是在快速地扫描、聚焦、比对。RAL 正是试图让模型通过 RL 习得这种隐式的、非语言的感知策略。

这给我们带来了几点深刻的启示:

1.

打开黑盒:强化学习不应该只停留在输出层。Transformer 内部丰富的中间状态(Attention, Activations)其实蕴含着巨大的可优化空间。

2.

去伪存真:在多模态领域,不要盲目迷信 CoT。有时候,“沉默的注视”比“喧闹的分析”更有力量。

3.

对齐的维度:真正的对齐,不仅是输出结果的对齐,更是思维过程(Attention Pattern)的对齐。

DeepMind 的这项工作,或许标志着多模态后训练正在从粗放的“结果导向”迈向精细的“过程导向”。未来的 Agent,不仅要能说会道,更要有一双由于经受过强化训练而变得“目光如炬”的眼睛。

Share Http URL: http://www.wittx.cn/get_news_message.do?new_id=1531

Best Last Month